「AI對齊」議題 數位部採取4大行動面對

【記者蕭文康/台北報導】有鑒於人工智慧(AI)近期蓬勃發展,但也帶來許多挑戰,「AI對齊」議題引發關注。確保其應用與全民利益保持一致,數位發展部指目前先從4大措施做起,包括成立AI評測中心、發布AI評測指引、成為國際非政府組織「集體智慧計畫」合作夥伴、舉辦「運用AI促進資訊完整性審議式民主活動」,邀請國際重要AI廠商進行交流,例如Meta、Google、Microsoft、OpenAI等與會廠商皆認同AI須具備可信任、準確性及安全等重要特性。

數位部強調,未來將持續與各界對話,致力推動可信任AI,協力創造社會所需的各項AI應用服務。

數位部去年5月成為國際非政府組織「集體智慧計畫」合作夥伴

有鑒於人工智慧(AI)近期蓬勃發展,為確保其應用與全民利益保持一致,以進一步創造社會所需的各項應用服務,數位部於 2023 年 5 月正式成為國際非政府組織「集體智慧計畫」(Collective Intelligence Project, CIP)合作夥伴,參與對齊大會(Alignment Assemblies)專案,期待協助台灣在全球公眾領域上,凝聚民眾對於人工智慧需求與風險之共識,共同處理「人工智慧對齊問題」(Alignment Problem)。

舉辦以台灣使用者為核心的AI對齊大會

數位部以「所有人都可以決定人工智慧發展方向」為其運作目標,使全民都能對人工智慧等變革式技術的發展方向,進行有意義的參與。因此於 2023 年開始,數位部陸續舉辦與補助以台灣使用者為核心的對齊大會,透過公民參與審議模式,形塑人工智慧發展方向,如透過點子松(Ideathon)活動,以台灣為示範場域,並與台灣人工智慧學校基金會合作,舉辦數場活動。

行政院正著手研擬《人工智慧基本法》草案

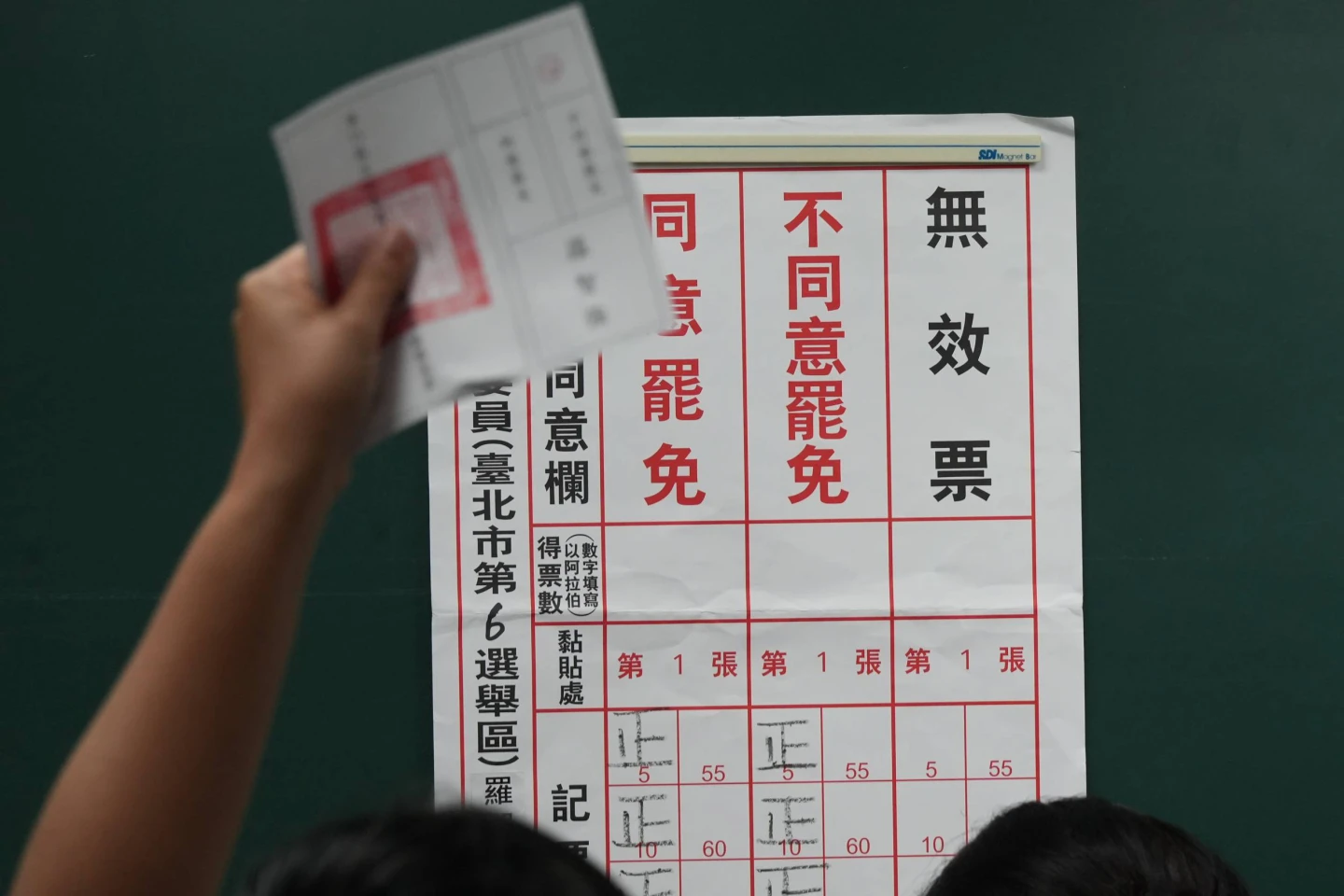

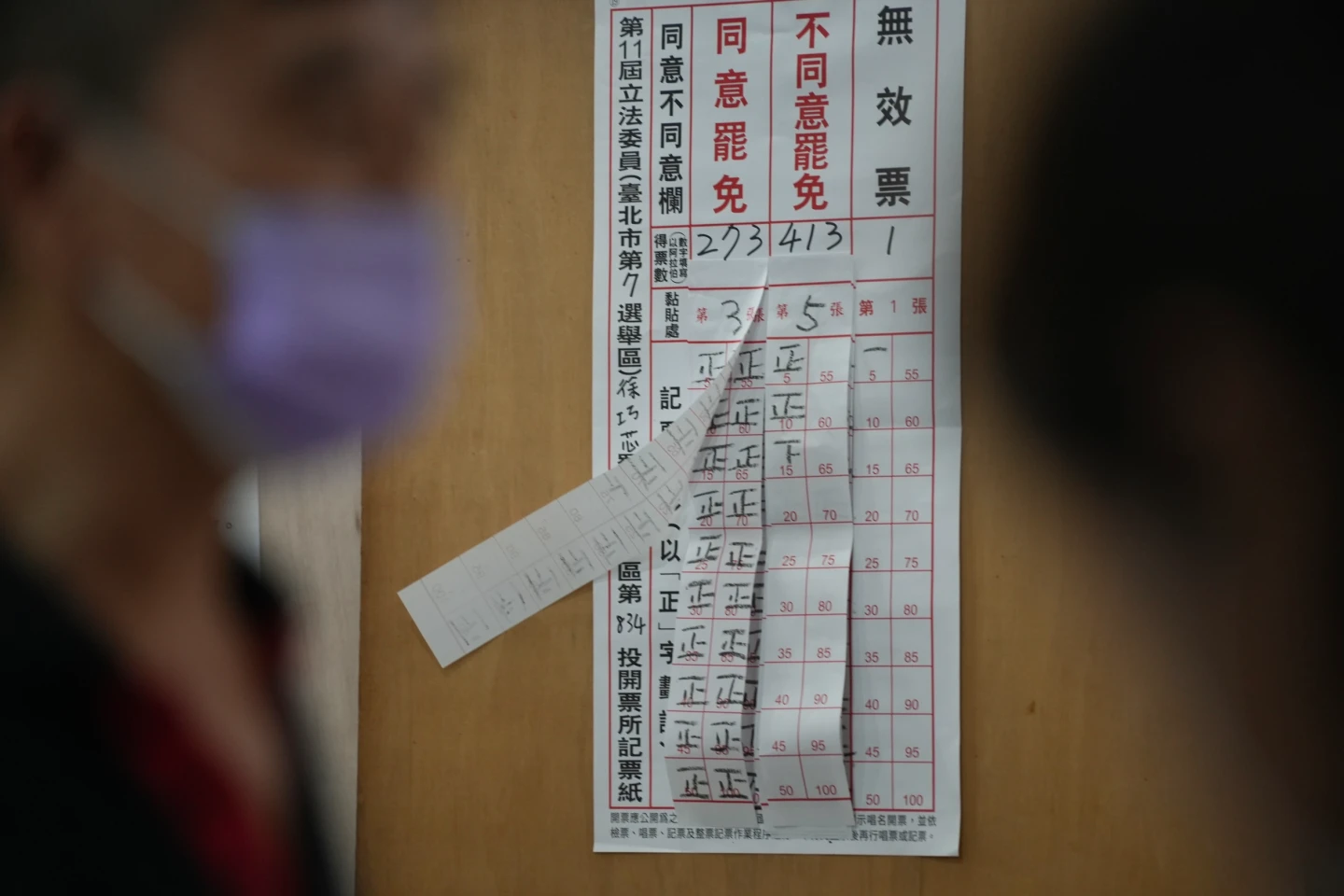

另數位部也在 2024 年 3 月辦理「運用 AI 促進資訊完整性」線上公民審議大會,透過分層隨機抽樣的方式,讓來自全台各地具統計代表性的公民在一個開放和平等的討論平台,共同探討如何運用 AI 來辨識和分析資訊的完整性等相關議題,以促進訊息的可信、可靠和完整性。

同時。因應生成式人工智慧熱潮引發社會關注相關議題,行政院正著手研擬《人工智慧基本法》草案,數位部也期待透過集體智慧計畫的先行示範,為政策制定者與技術開發者提供重要資訊,以確保人工智慧發展與群眾利益保持一致。

辦理「運用 AI 促進資訊完整性」線上公民審議大會

數位近期推動多項AI政策與工作,包括成立AI評測中心、發布AI評測指引、成為國際非政府組織「集體智慧計畫」合作夥伴等。今年更進一步舉辦「運用AI促進資訊完整性審議式民主活動」,並邀請國際重要AI廠商進行交流,Meta、Google、Microsoft、OpenAI等與會廠商皆認同AI須具備可信任、準確性及安全等重要特性。數位部未來將持續與各界對話,致力推動可信任AI,協力創造社會所需的各項AI應用服務。

對生成式AI內容進行分析及辨別方面,國際廠商皆在會中提出已建立或即將導入的相關作法,包括SynthID技術(用於AI生成圖片中建立浮水印,或偵測AI生成圖片中的浮水印,以方便辨識AI生成的圖片)等AI生成內容偵測技術、溯源標註及簽章、用戶檢舉機制,以及提醒用戶注意AI生成內容等作法。

藉由本次活動蒐集與彙整民眾及AI國際廠商的意見,未來數位部將持續敦促網路平台業者推動資訊辨別與分析機制,而使用者於網路平台所刊登或推播之內容,若含有使用深度偽造技術或人工智慧生成之個人影像,應明確說明或標註,以確保資訊完整性。

此外,為進一步回應各界對正確應用AI於公共治理的期許,數位部與國立陽明交通大學科技與社會研究所、財團法人工業技術研究院以及史丹佛大學審議民主中心等單位合作,於今年3月23日舉辦「運用AI促進資訊完整性審議式民主活動」,透過「111」政府專用短碼簡訊平台,隨機發送簡訊邀請公民參與。共邀集450位專家學者、公民、社群和數位從業者,線上討論運用AI來辨識和分析資訊的完整性等相關議題。活動引起廣大回響,可見民眾對於AI運用於推動資訊完整性具有高度期待。

數位部強調,面對AI技術帶來的資訊完整性挑戰,需要平台、政府和民眾的共同努力,藉由建立透明的監管機制,並加強公眾對AI生成內容的辨識能力,以促進資訊真實性與完整性;民主審議亦將強化社會韌性,未來數位部也將持續建立兼顧科技創新及風險治理的可信任AI發展環境,包括人才優化及留才攬才、重視AI倫理法制、推動資料治理及流通,建構以人為本的健全數位生態系。