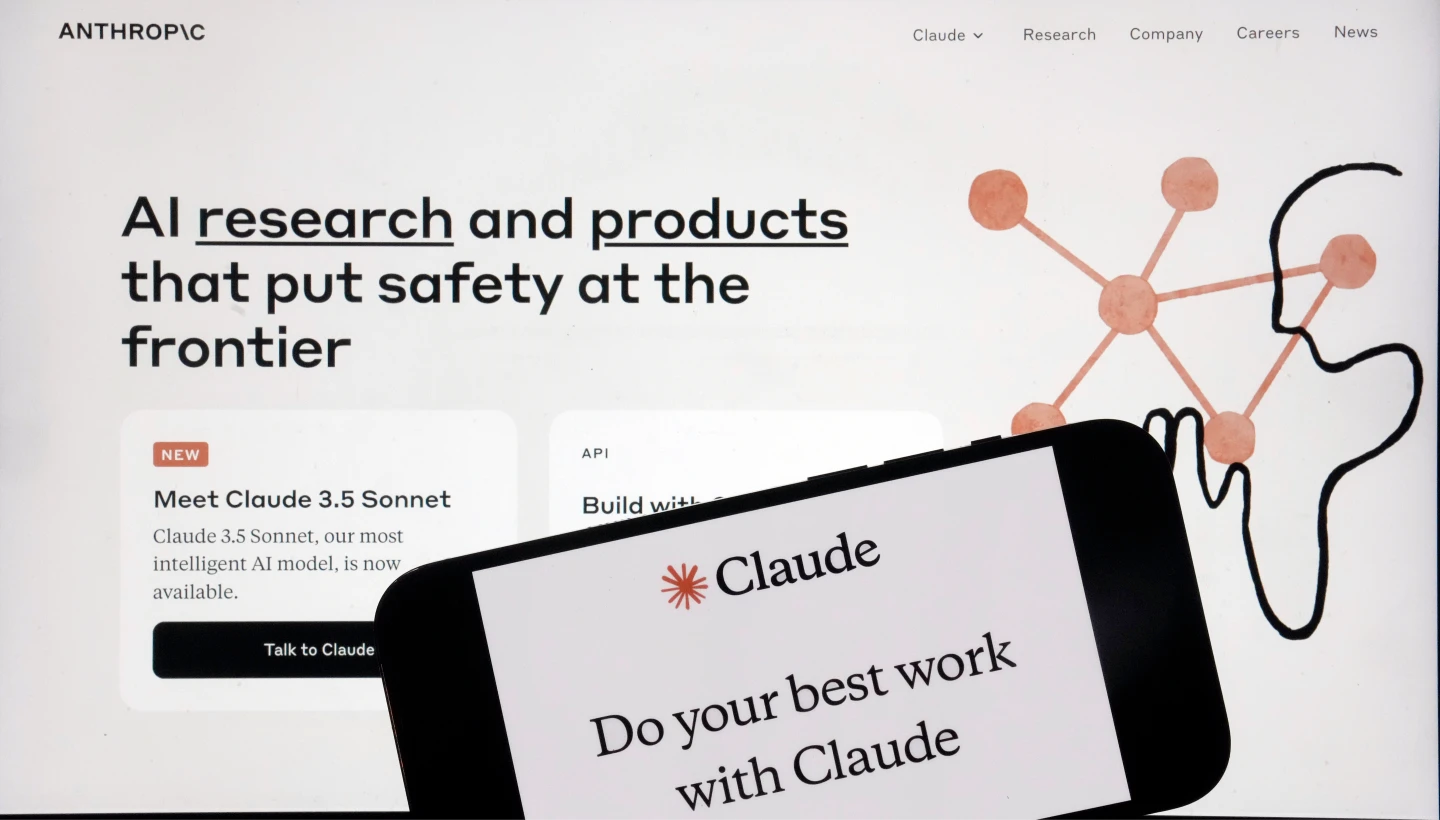

OpenAI阿特曼掛帥新安全團隊 「球員兼裁判」成效等著看

【張翠蘭/綜合外電】美國科技公司OpenAI數名高級安全管控人員日前陸續出走,引發各界關注這家AI先驅在對抗Google「Gemini」AI模型和科技大亨馬斯克旗下新創xAI等激烈競爭的同時,能否做好產品安全把關。對此,OpenAI周二(5/28)宣布成立新的安全保障監委會,由執行長阿特曼等人領軍。

英國《金融時報》5月28日報導,OpenAI企圖藉由新的人工智慧(AI)安全團隊成軍,向公司決策階層保證,研發過程中會優先做好產品安全把關。

這個新委員會將由執行長阿特曼(Sam Altman)和董事會董長泰勒(Bret Taylor)、 丹吉羅(Adam D’Angelo)和塞利格曼(Nicole Seligman)領導,並就OpenAI運作的關鍵安全決策向董事會其餘3名成員報告。

90天內做出評估報告

彭博則指,這個安全保障監督委員會是為了排除外界對其先進AI技術風險日益增加的擔憂。新委員會首個任務是將在接下來的90天內,徹底評估OpenAI現有AI模組的保護措施。調查結果將彙編成報告供董事會審查,然後公開所採用更新過的安全建議。

然而,產品決策與監督者都是同一人,等同「球員兼裁判」,OpenAI研究的安全性能否重新獲得公眾信任,取決於該委員會的透明度和有效性。

重量級安全團隊日前解散

本月14日,曾就AI發展速度而與阿特曼起內訌的公司聯合創辦人暨首席科學家蘇茨克維(Ilya Sutskever)宣布離職,OpenAI隨即宣布解散他率領的「超智慧對齊」(superalignment)團隊;該團隊任務是關注研發中的超級智慧系統安全性,以防止出現失控且終結人類文明的強AI。

超智慧對齊團隊的關閉導致數名員工相繼離開公司,包括團隊另一位關鍵領導人暨高級AI安全研究員萊克(Jan Leike)。

挨批閃亮產品的重要性優於安全流程

萊克離開時,更在X平台發文批OpenAI的「安全文化和流程被放在次要位置,讓位給『閃亮的產品』」。此番言論讓OpenAI的AI技術安全風險管控,成為各界以放大鏡檢視的焦點。

美國財經頻道CNBC分析指出,自OpenAI於2022年底推出AI聊天機器人ChatGPT,掀起生成式AI產品和投資的熱潮以來,AI安全在整個科技領域迅速變得重要起來。但業內人士表示擔心,一些公司在沒有充分考慮潛在社會危害的情況下,過於急促向公眾發布功能強大的AI產品。

由於AI目前尚未具有自我檢查的能力,可能衍生難以預測的問題。